Résultats de recherche pour : *

Affinez les résultats

Sélectionnez des éléments pour filtrer les résultats

- 70Tag

- 69Fact Check

- 69Claim Review

- 1Publication

Non, cette vidéo d'un immeuble qui s'effondre n'a pas été filmée après le tremblement de terre en Turquie

La vidéo d'un imposant immeuble qui s'effondre est présentée à tort sur les réseaux sociaux comme ayant été filmée en Turquie après le séisme meurtrier du 6 février. Mais elle n'a rien à voir : elle a été prise en Arabie Saoudite, dans la ville de Djeddah et circule en ligne depuis janvier. Le violent tremblement de terre qui a touché le sud de la Turquie et le nord de la Syrie a tué plus de 17.000 personnes, selon les bilans au 9 janvier et détruit des milliers de bâtiments. [+]

Publié le lundi 13 février 2023 à 11:05 - Source : Factuel - AFP

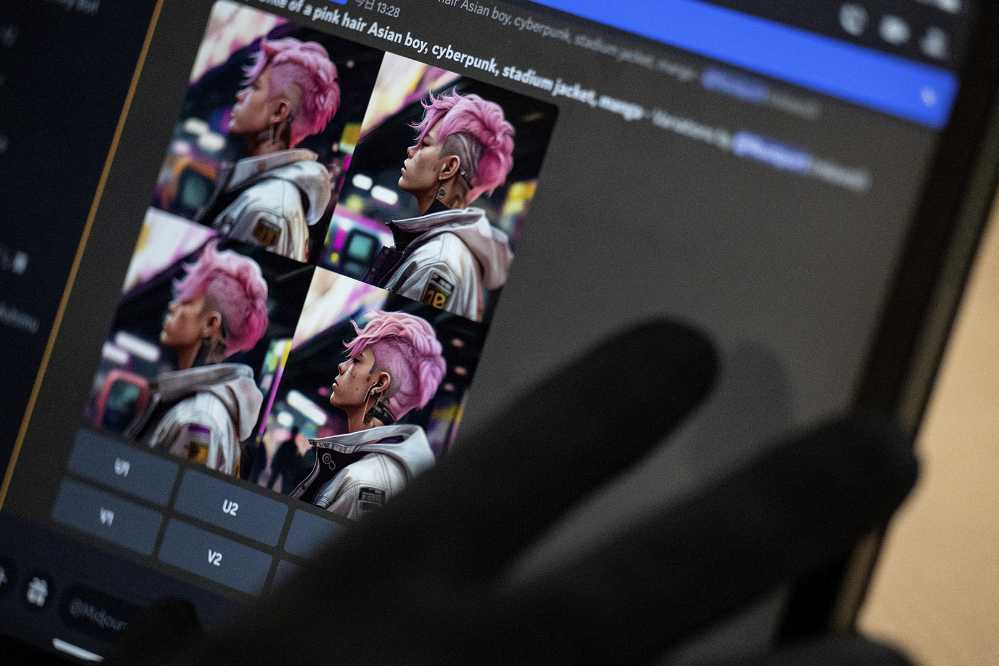

Reconnaître des images générées par IA : quelques indices, beaucoup de bon sens

Midjourney, DALL-E, Stable Diffusion, Craiyon... les progrès fulgurants de l'intelligence artificielle ces derniers mois ont donné lieu à un nouveau phénomène : le partage massif sur les réseaux sociaux d'images générées de manière artificielle. Certaines, ultraréalistes et ancrées dans l'actualité politique, ont semé la confusion, parfois présentées comme authentiques. S'il n'existe pas, à ce jour, d'outil capable d'identifier avec certitude une image générée artificiellement, recontextualiser le cliché et repérer des incohérences visuelles peut permettre de déceler une création d'IA, ont expliqué plusieurs spécialistes à l'AFP. [+]

Publié le jeudi 23 mars 2023 à 18:56 - Source : Factuel - AFP

Derrière ces images émouvantes de chiens abandonnés, une technique d'hameçonnage bien rodée

"Mon petit chien n'est pas rentré", "j'ai frappé ce chien avec mon camion, merci de remonter ce post pour m'aider à trouver le propriétaire" : des publications appelant à l'aide pour retrouver des chiens "perdus" ou à l'inverse leurs propriétaires sont régulièrement relayées sur les réseaux sociaux. Attention : ces messages, conçus pour apitoyer les internautes à l'aide d'images touchantes et de favoriser les partages, sont dans un second temps modifiés et remplacés par une arnaque visant à faire la promotion de sites marchands et de récupérer des données personnelles. [+]

Publié le vendredi 31 mars 2023 à 11:53 - Source : Factuel - AFP

Cette vidéo montre l'éruption du volcan Sinabung en février 2018 et non du volcan Merapi en mars 2023

Le 11 mars 2023, le volcan Merapi, en Indonésie, est entré en éruption, crachant de la fumée et des cendres recouvrant les villages situés à proximité. Dès le lendemain, une vidéo d'éruption volcanique a commencé à circuler abondamment sur les réseaux sociaux, présentée comme des images du Merapi. Toutefois, la vidéo montre en réalité l'éruption du volcan Sinabung - situé également en Indonésie- qui a eu lieu en 2018. Elle avait été déjà été publiée à plusieurs reprises en février 2018, notamment par le porte-parole de l'Agence nationale indonésienne de gestion des catastrophes. [+]

Publié le jeudi 13 avril 2023 à 11:16 - Source : Factuel - AFP

Macron en éboueur, pape en doudoune, Trump en état d'arrestation... Comment repérer les images générées par l'intelligence artificielle

Les images produites par les IA ont atteint un niveau de réalisme sans précédent. Franceinfo vous livre ses conseils pour éviter les pièges. [+]

Publié le jeudi 20 avril 2023 à 10:40 - Source : France TV

Ces photos d'enfants dans des "rituels sataniques" ont été créées par intelligence artificielle

Des photos générées par IA et partagées sur les réseaux sociaux dans plusieurs langues prétendant à tort montrer des enfants participant à une cérémonie satanique aux Etats-Unis. Certaines de ces publications lient faussement ces images au SatanCon, un événement créé par une organisation appelée The Satanic Temple. La personne ayant créé ces images a expliqué à l'AFP qu'elles avaient été générées par IA et qu'elles n'avaient aucun lien avec le SatanCon. [+]

Publié le vendredi 12 mai 2023 à 15:13 - Source : Factuel - AFP

Attention à cette intox sur les mutilations des nez des statues égyptiennes

Une photo montrant une statue égyptienne au nez mutilé est très partagée sur Facebook au Cameroun depuis le 8 mai. Selon la page qui la publie, elle est la preuve que "les archéologues européens ont ressenti le besoin de casser le nez des statues pour masquer" le fait que les pharaons égyptiens étaient en réalité noirs. Si les raisons derrière les mutilations, modifications ou destructions partielles ou totales des statues de l'Egypte antique sont multiples, aucune ne concerne l'hypothétique volonté de dissimuler des traits prouvant que les pharaons étaient noirs, selon plusieurs spécialistes. [+]

Publié le vendredi 19 mai 2023 à 12:04 - Source : Factuel - AFP

Cette séquence ne montre pas une "femme artificielle" fabriquée en Chine, elle vient d'un jeu vidéo

Une vidéo affirmant montrer une "femme artificielle fabriquée en Chine" circule sur TikTok et Facebook en Afrique de l'Ouest depuis fin mars. Les internautes affirment que ce robot viendrait d'être commercialisé sur le marché chinois. Il s'agit en réalité d'une séquence publicitaire promouvant "Detroit: Become Human", un jeu vidéo développé par le studio Quantic Dream sorti en mai 2018. Il n'existe aucune trace à date de publication de cet article que la Chine ait commercialisé des robots similaires à l'androïde visible dans cette séquence. [+]

Publié le mardi 23 mai 2023 à 10:53 - Source : Factuel - AFP

Flux RSS pour la recherche sur le terme [*]